Introduction

Accès à l'information et réseaux de neurones

- Les modèles de RI classique

- limités en expressivité

- échouent sur des besoins d'information complexes

- Modèles neuronaux - des succès:

- reconnaissance de la parole

- détection d'objets

- Modèles neuronaux - des progrès en NLP:

- segmentation de texte

- question-réponse

- traduction

- Intérêt : plus de "souplesse" dans la modélisation

Plan du cours

- Représentation continue des mots

- Réseaux de neurones en RI

- Modification de modèles existants

- Modèles de représentation

- Modèles d'interaction

- Comment apprendre ?

Représentation

Données textuelles

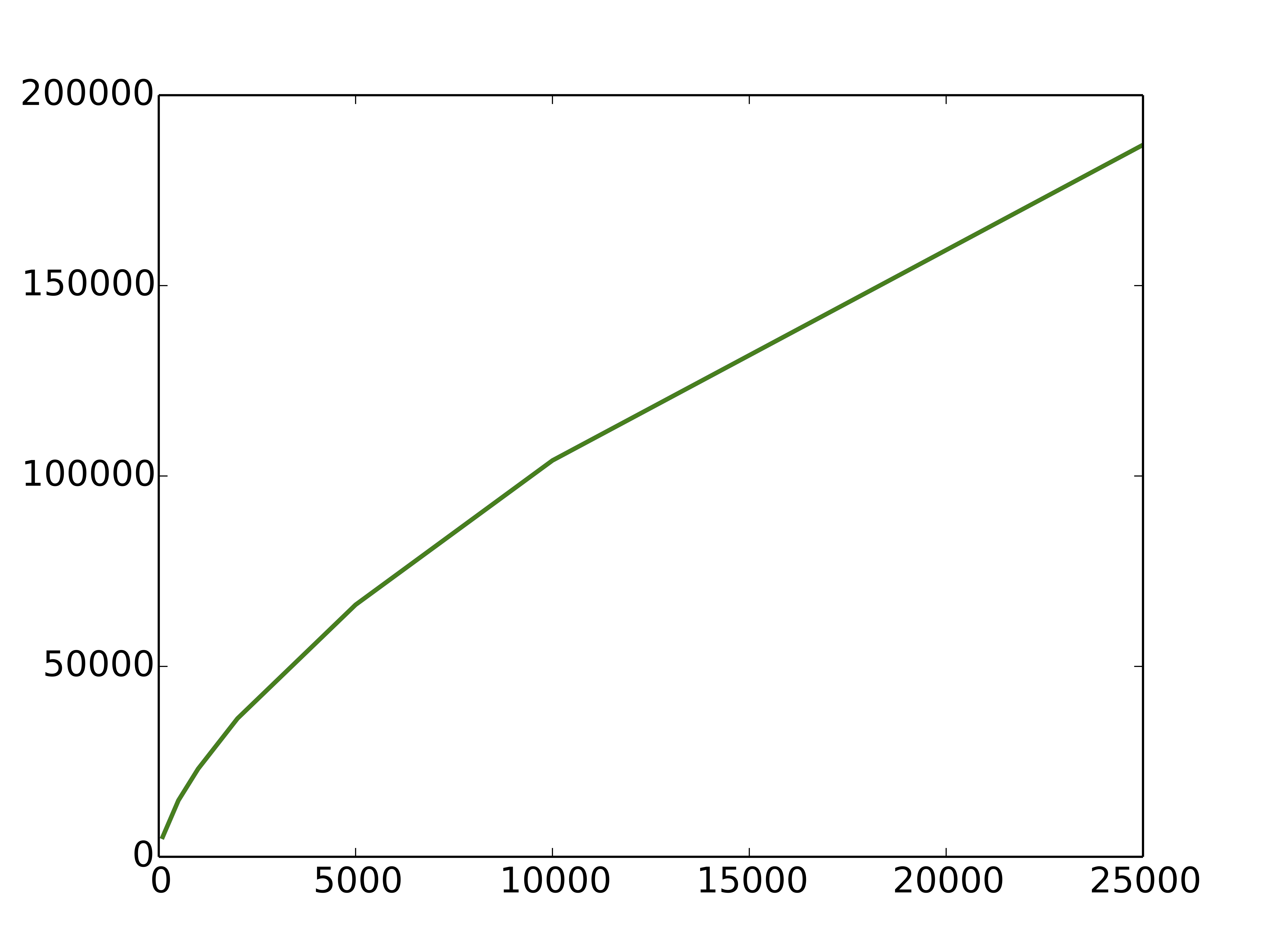

Particularités

- Structure

- Pas de distance naturelle

- De nombreuses variations (style, langue, ...) pour une même sémantique

Représentation

- Logique

- "One-hot", "sac de mots", etc.

- Index facile

- Pas de notion de proximité

- précision 1, rappel 0

- Distribuée ou continue

- Chaque entité est plongée dans $\mathbb{R}^n$

- Index : difficile

- Notion de proximité

- rappel 1, précision 0

Selon l'application, on peut utiliser l'un ou l'autre – ou les deux !

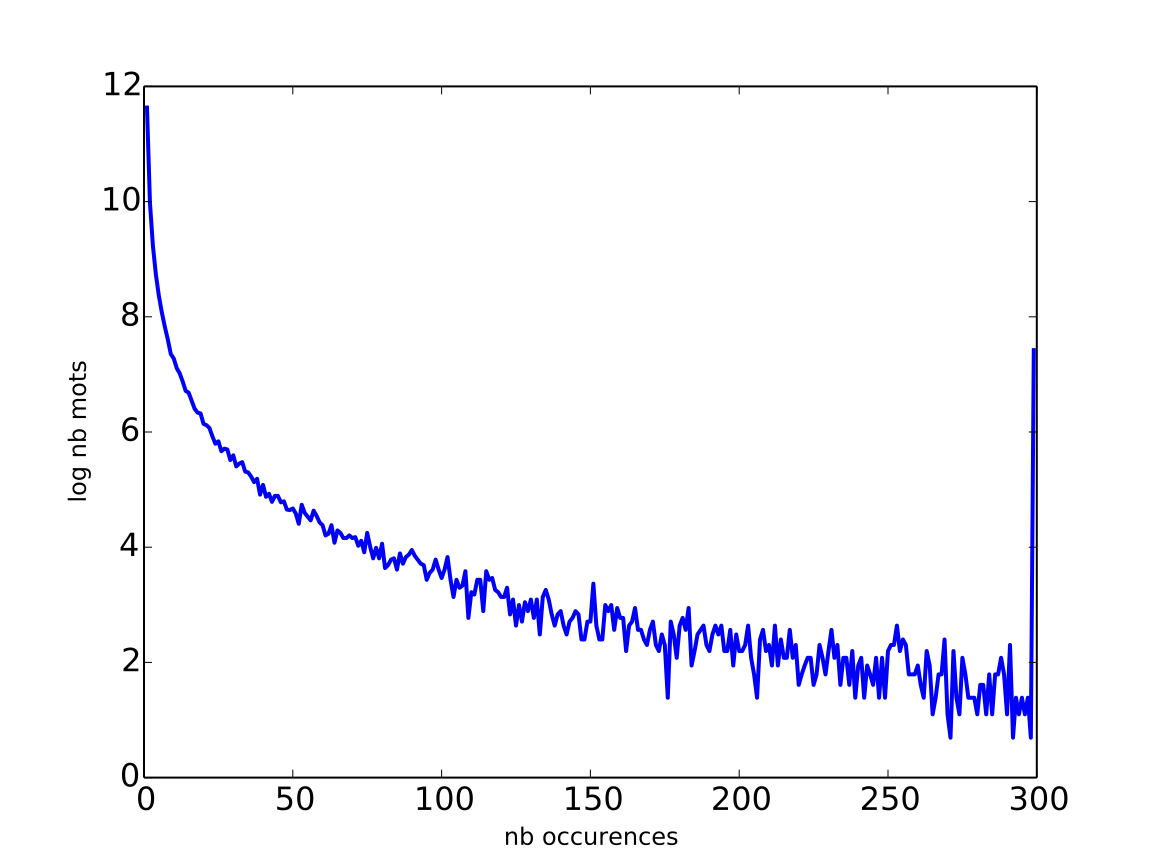

Limites des modèles basés sur le mot

- Morphologie ? mais: félin

- Son ? mais: Chas

Solution : espaces sémantiques

- chez le dentiste

- à l'école

- sur la lune

- ...

Solution : Graphe des co-occurrences

Solution : Proximité dans l'espace = co-occurrence

Apprendre en maximisant la vraissemblance sur des couples $(w,c)$ implique $$ x_w \cdot x_c = \frac{p(w, c)}{p(w)p(c)} - \log k$$

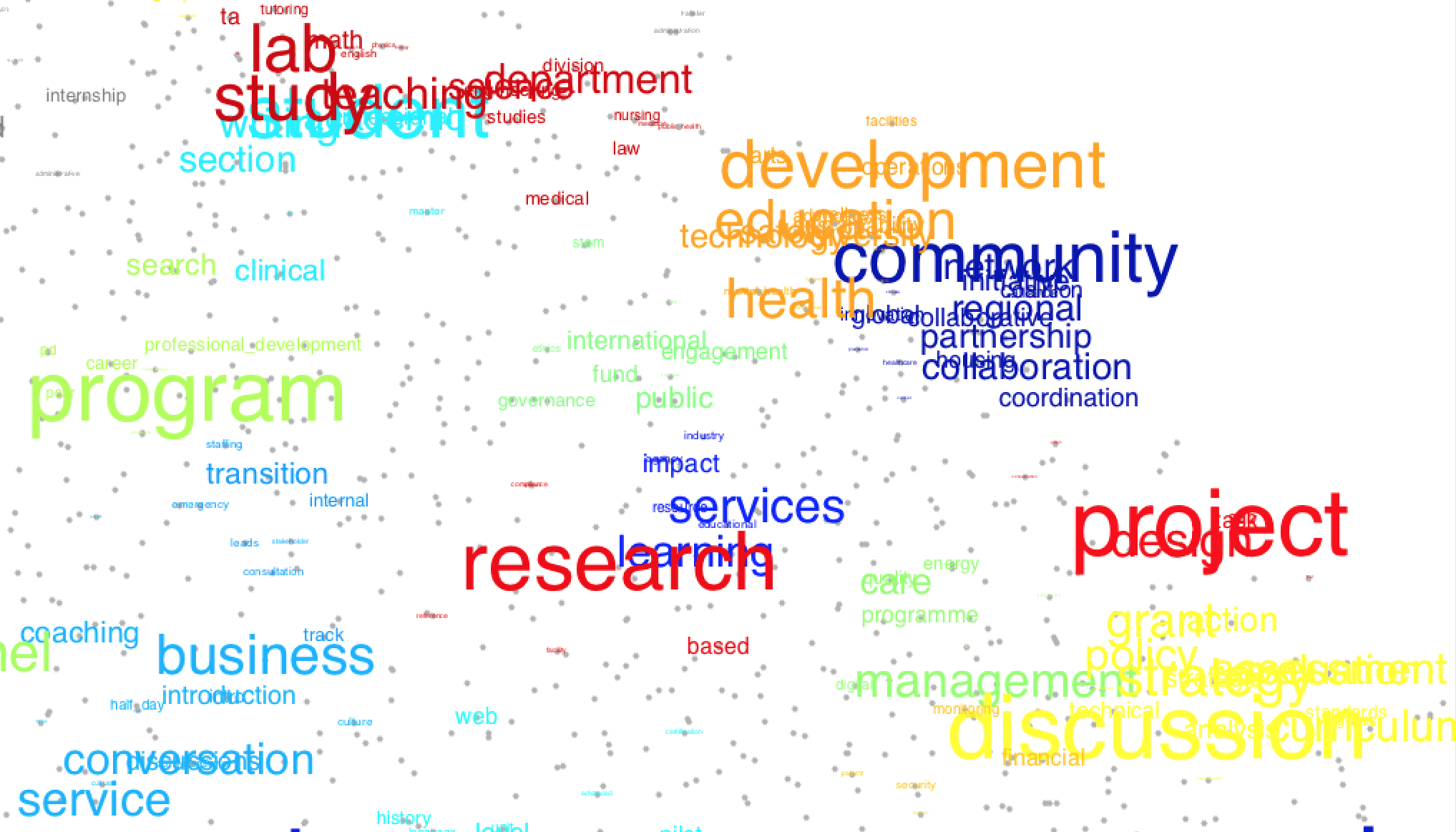

Solution : espaces vectoriels

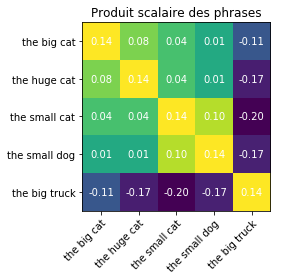

Espaces de représentation: similarités

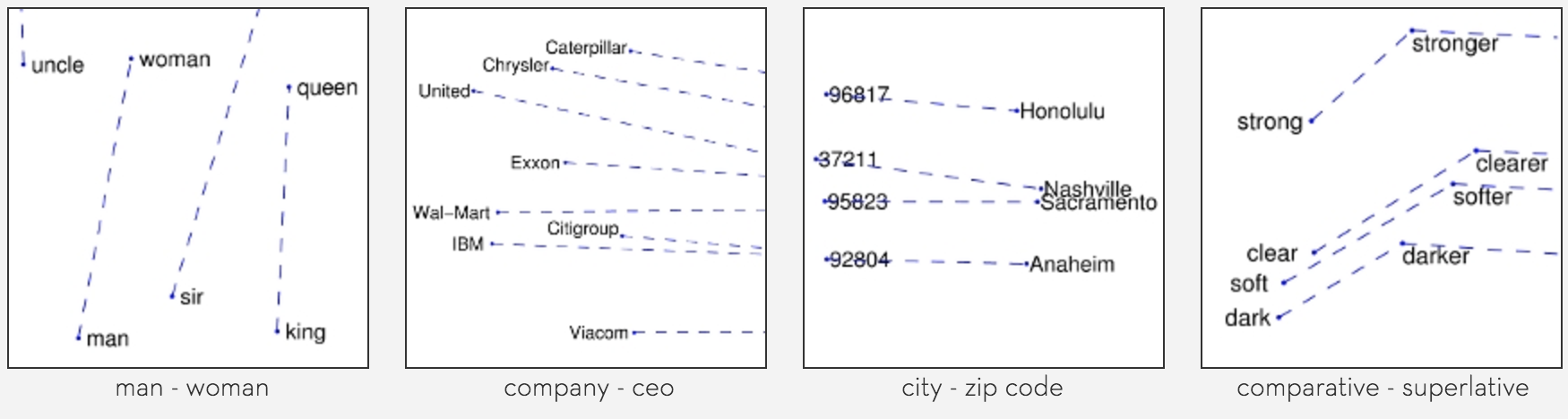

Espaces de représentation: relations

Unités de langue

[ ▁les] [▁ter] [m] [ites] [,] [▁archite] [ctes] [▁bi] [oc] [li] [matiques]

Connexion avec les réseaux de neurones

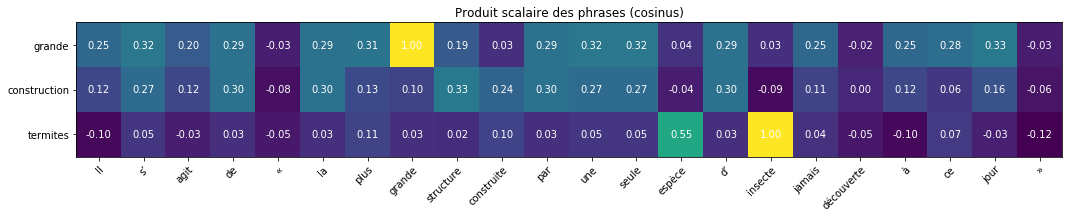

- Les mots sont liés dans l'espace : produit scalaire fort = proximité sémantique

- Les réseaux neurones permettent de détecter des motifs

L'apprentissage de représentation

Utilisation en RI

- Clustering & Classification

- Recherche documentaire

- Question-réponse

Problématiques

Problématiques: Annotation du texte

| mot 1 | mot 2 | mot 3 | mot 4 | ... |

| cl. 1 | cl. 2 | cl. 3 | cl. 4 | ... |

- Applications

- Segmentation

- Détection d'entités nomméees

- Annotation sémantique

Problématiques: Annotation du texte

On classifie chaque mot dans la classe B (begin) | E (end) | I (intermediate) - Type

| Sophie | est | allée | boulevard | Jean | Jaurès |

| EB-Nom | NA | NA | B-Lieu | I-Lieu | E-Lieu |

Résultat

- Nom: Sophie

- Lieu: boulevard Jean-Jaurès

Problématiques: Classification d'un texte

| mot 1 | mot 2 | mot 3 | mot 4 | ... |

| classe | ||||

- Applications

- Classification de textes

- Extraction d'information

- Détection de sentiments

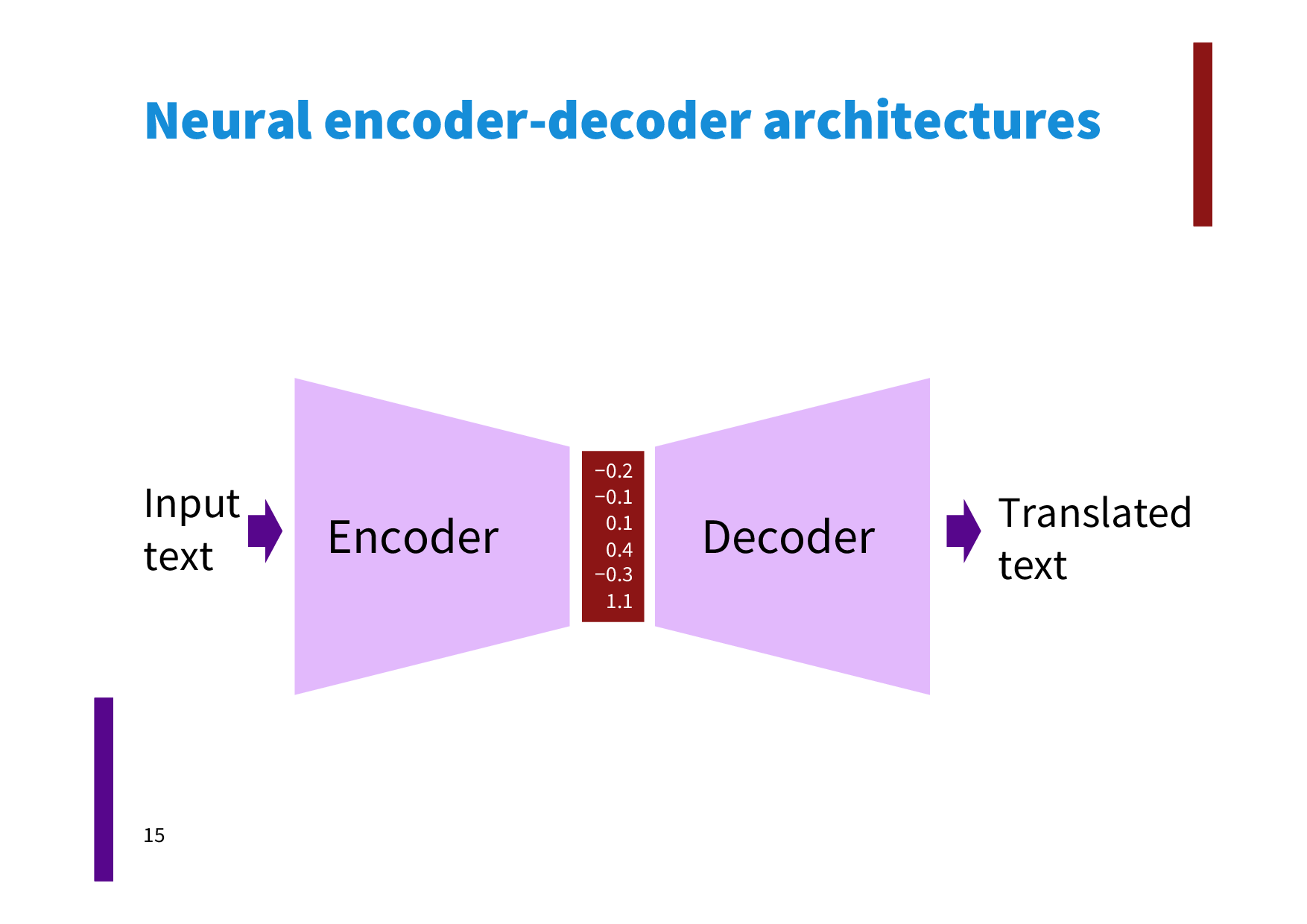

Problématiques: Générer du texte

- Applications

- Traduction automatique

- Annotation d'images

- Data-to-text

Problématiques: Similarité de textes

- Applications

- Recherche d'information (question / document ou question / réponse), inférence textuelle (implication)

- Problématiques associées

- efficacité (index, pré-sélection)

On peut distinguer trois grandes classes d'approches

- Modification de modèles classiques

- Modèle neuronaux

- représentation vs d'interaction

- symétrique vs asymétrique

Utilisation des espaces continus

Learning to reweight query terms

Dans le BIM (Binary Independance Model), on a

But: estimer $p(t|R, q)$

- Utilise la représentation $x_t$ de chaque terme

- Moyenne $\bar x = \frac{1}{|q|} \sum_{t\in q} x_t$

- Entrée = déviation par rapport à la moyenne = $x_t - \bar x$

- Sortie désirée : $p(t|R,q)$

- Coût quadratique

Modèle de traduction

Idée du papier = $$p_u(v|d) \propto \cos(v, w) $$

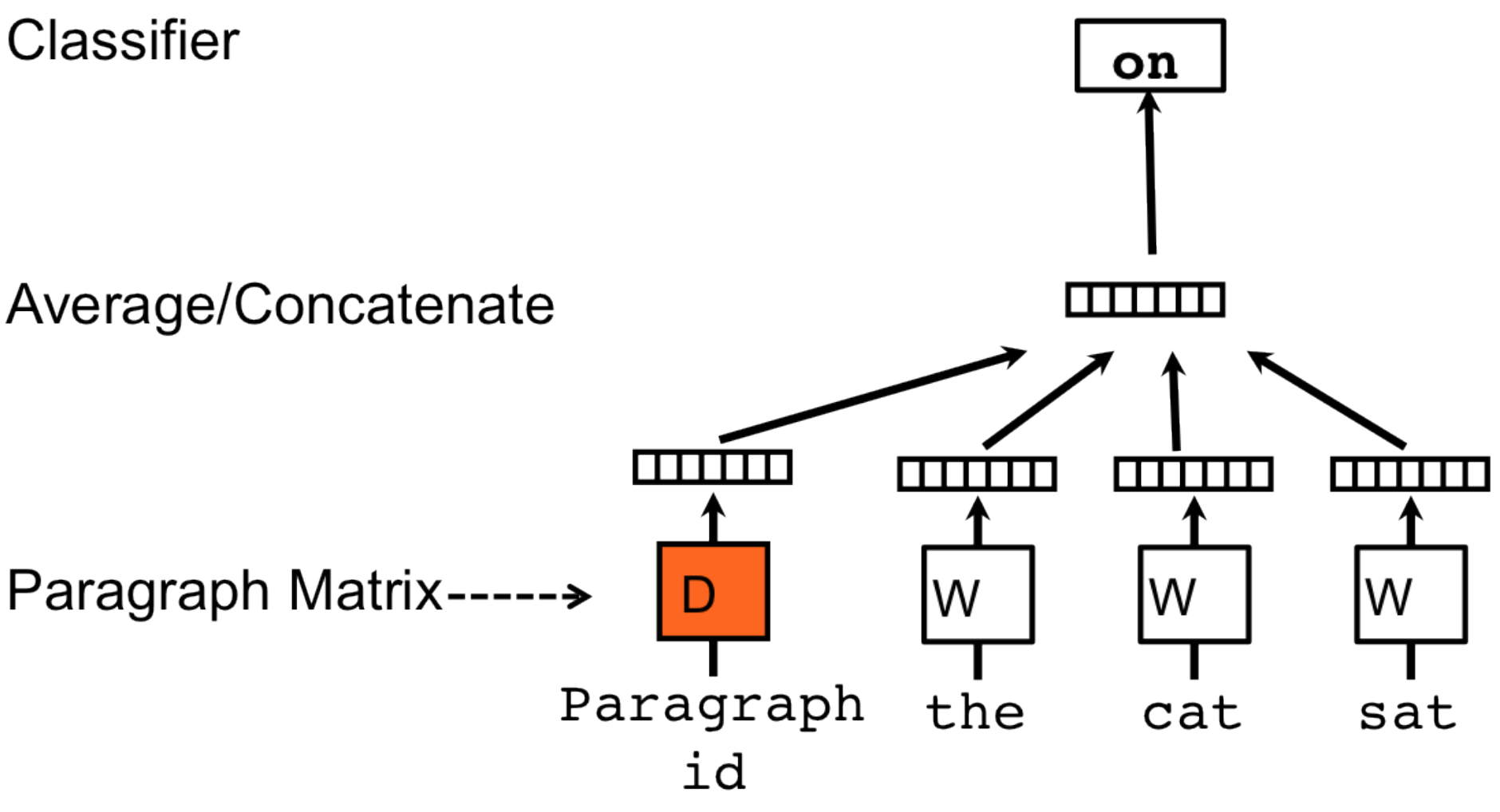

PV-DBOW: Introduction

PV-DBOW

Point de départ: modèle de langue

$$ p(w|d) = (1-\lambda) p_{QL}(w|d) + \color{red}{\lambda p_{PV}(w|d)} $$Une adaptation du modèle C-BOW (Word2Vec)

- Échantillonage spécifique

- Prise en compte de la longueur

- Prise en compte du document

Plongements de documents

Plongements de textes

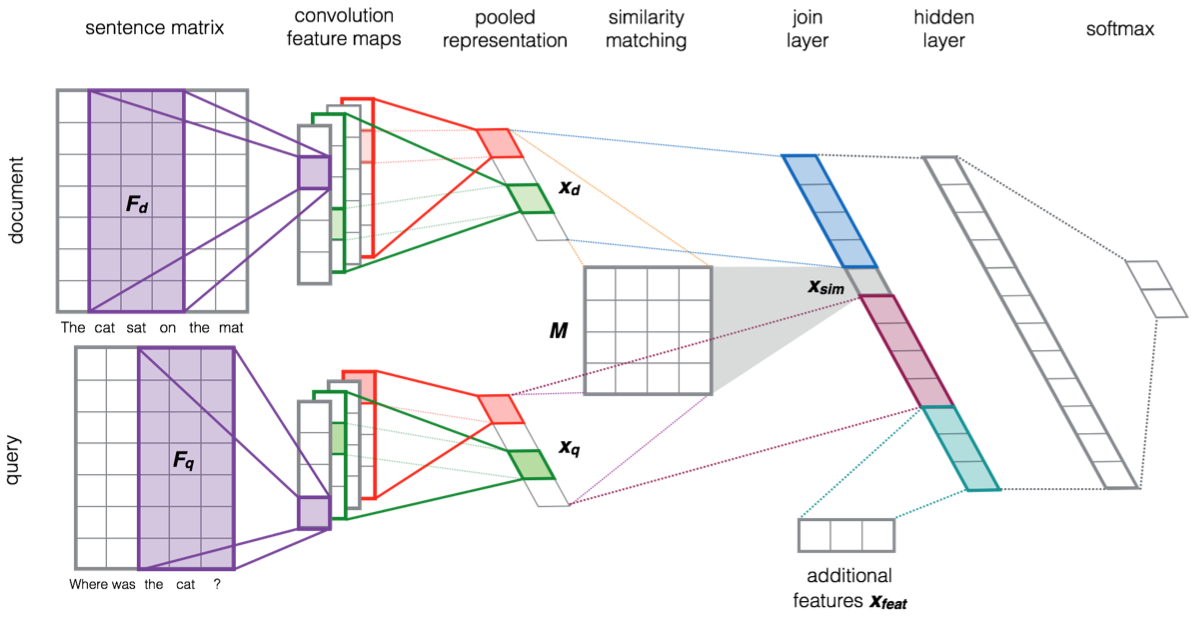

- Modèle symétrique $s(t_1, t_2) = g(f_\theta(t_1), f_\theta(t_2))$

- Modèle asymétrique $s(t_1, t_2) = g(f^{(l)}_\theta(t_1), f^{(r)}_\theta(t_2))$

- Le texte est une séquence (de mots, de caractères)

- Les réseaux de neurones traitent des entrées de taille fixe

- Comment faire ???

- On exploite la séquentialité = récurrence

- On exploite l'invariance temporelle = convolution

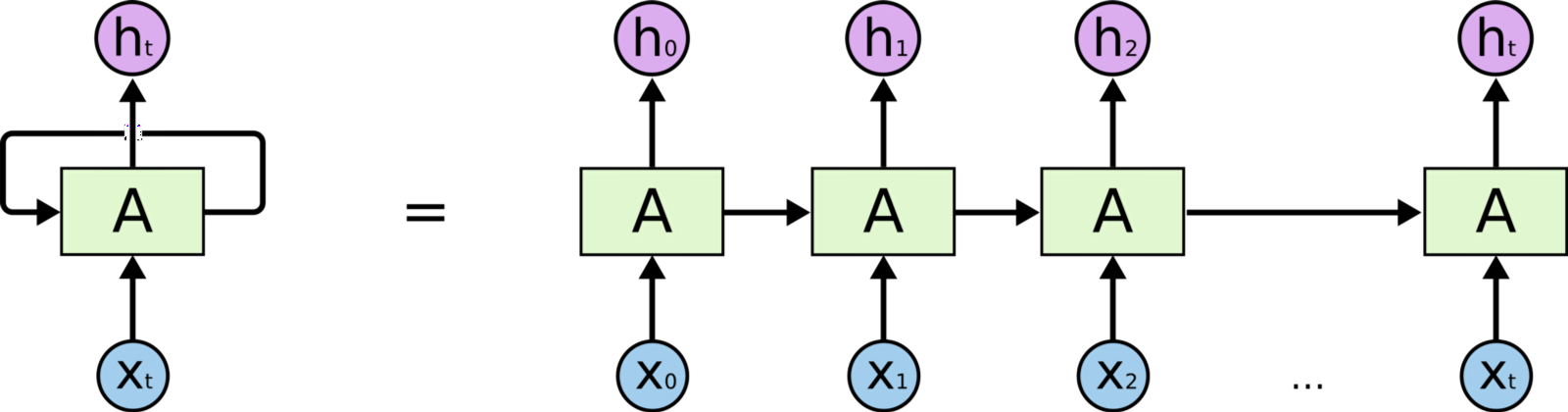

Réseaux récurrents

- À chaque pas de temps, on met à jour $s_t$

- L'état final représente la séquence

- Perte d'information sur des séquences longues (> phrase)

- Problème d'apprentissage (vanishing/exploding gradient)

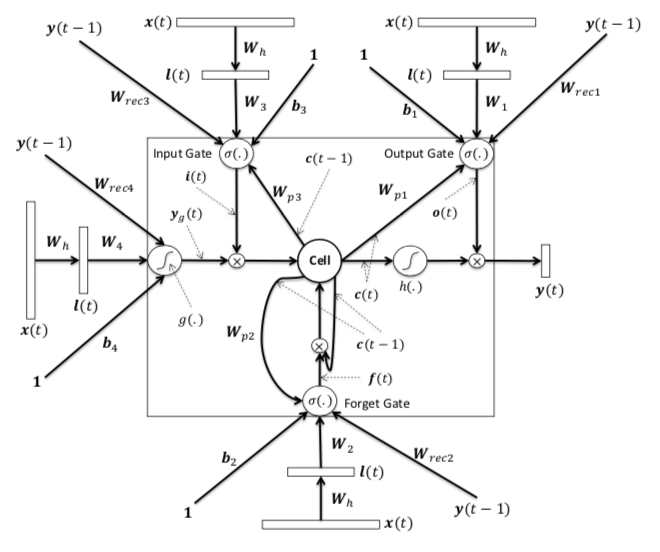

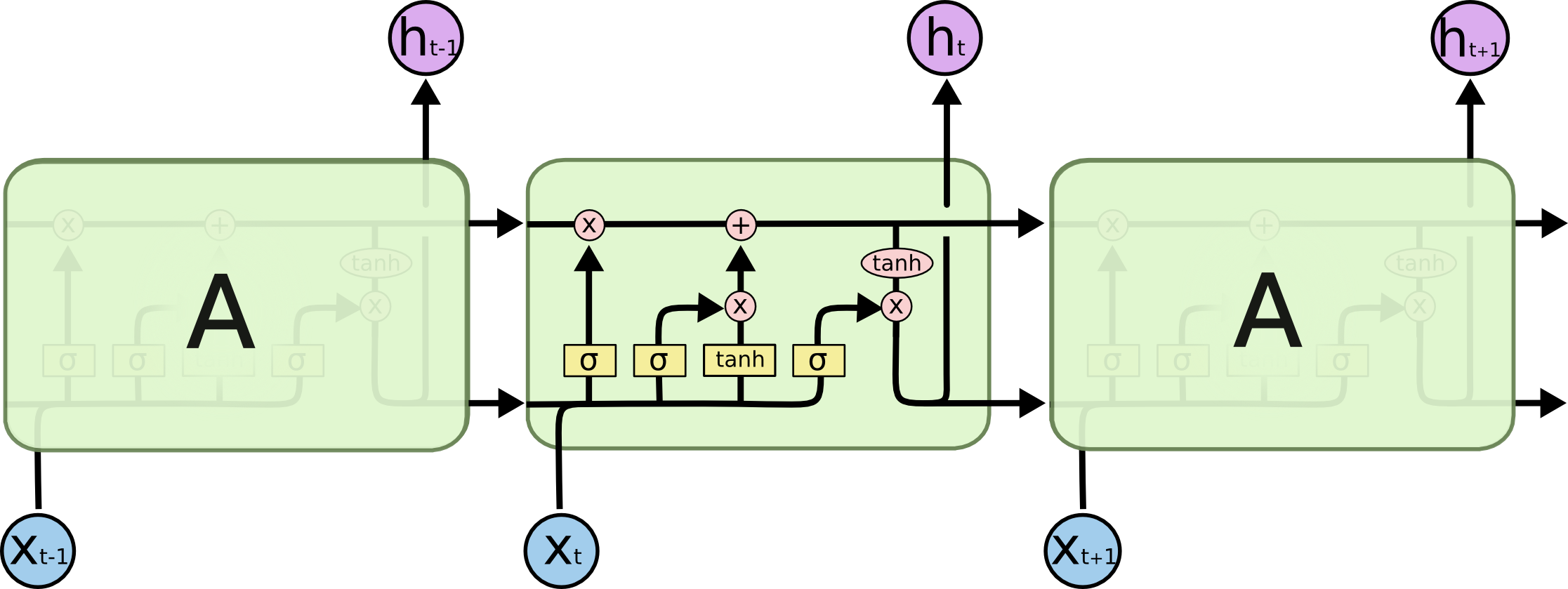

Réseaux récurrents: Gated Units

Utilisation d'unités avec des "portes"

- Oubli (forget gate) $c^\prime_t = g_f(x_t, h_{t-1}) \otimes c_{t-1} $

- Mise à jour (update gate) $c_t = c^\prime_t + g_u(x_t,h_{t-1}) \otimes f_u(x_t,h_{t-1})$

- Sortie (output gate) $h_t = g_o(x_t, h_{t-1}) \otimes \tanh(c_t)$

LSTM-RNN

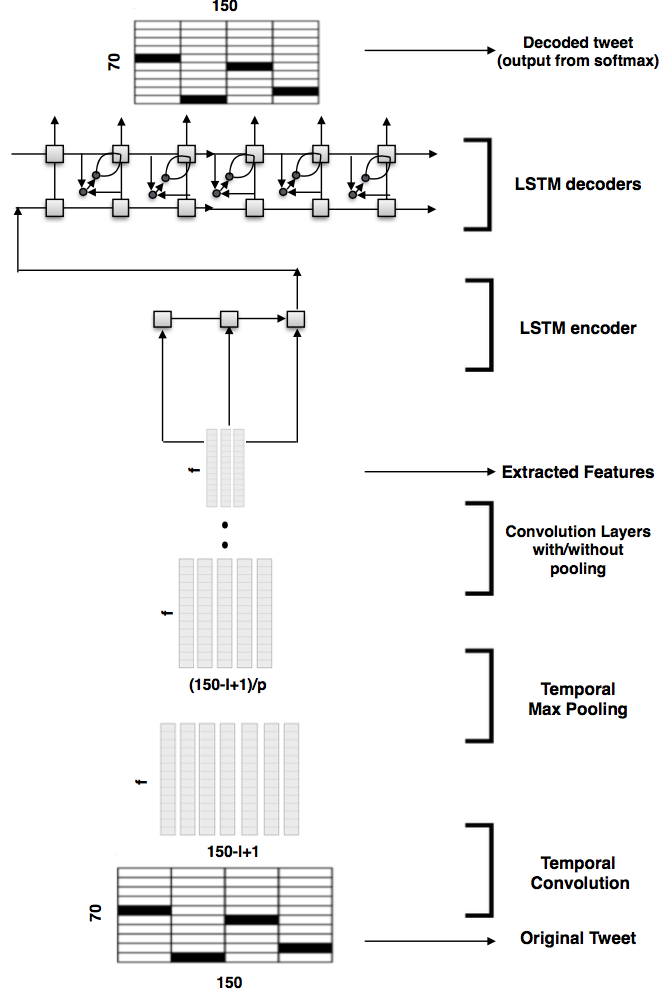

Textes courts: Tweet2Vec

- CNN (caractères) + LSTM

- Entrainement: auto-encodage sur 3 million de tweets (SemEval 2015-Task 1)

- Analyse de sentiments et similarité sémantique

Vosoughi, S., Vijayaraghavan, P., & Roy, D. Tweet2Vec: Learning Tweet Embeddings Using Character-level CNN-LSTM Encoder-Decoder. SIGIR 2016

Masques : Convolution et pooling

Idée : Composition de représentations de plus en plus abstraites- Texte : caractère → mot → clause → phrase → histoire

- Image : pixel → bords → motif → partie → objet

À chaque fois : invariance (1D, 2D) :

Opération répétée sur une sous partie de l'entrée

Convolution: détecter 01 avec 1 couche

Convolution: détecter 0101 avec 2 couches

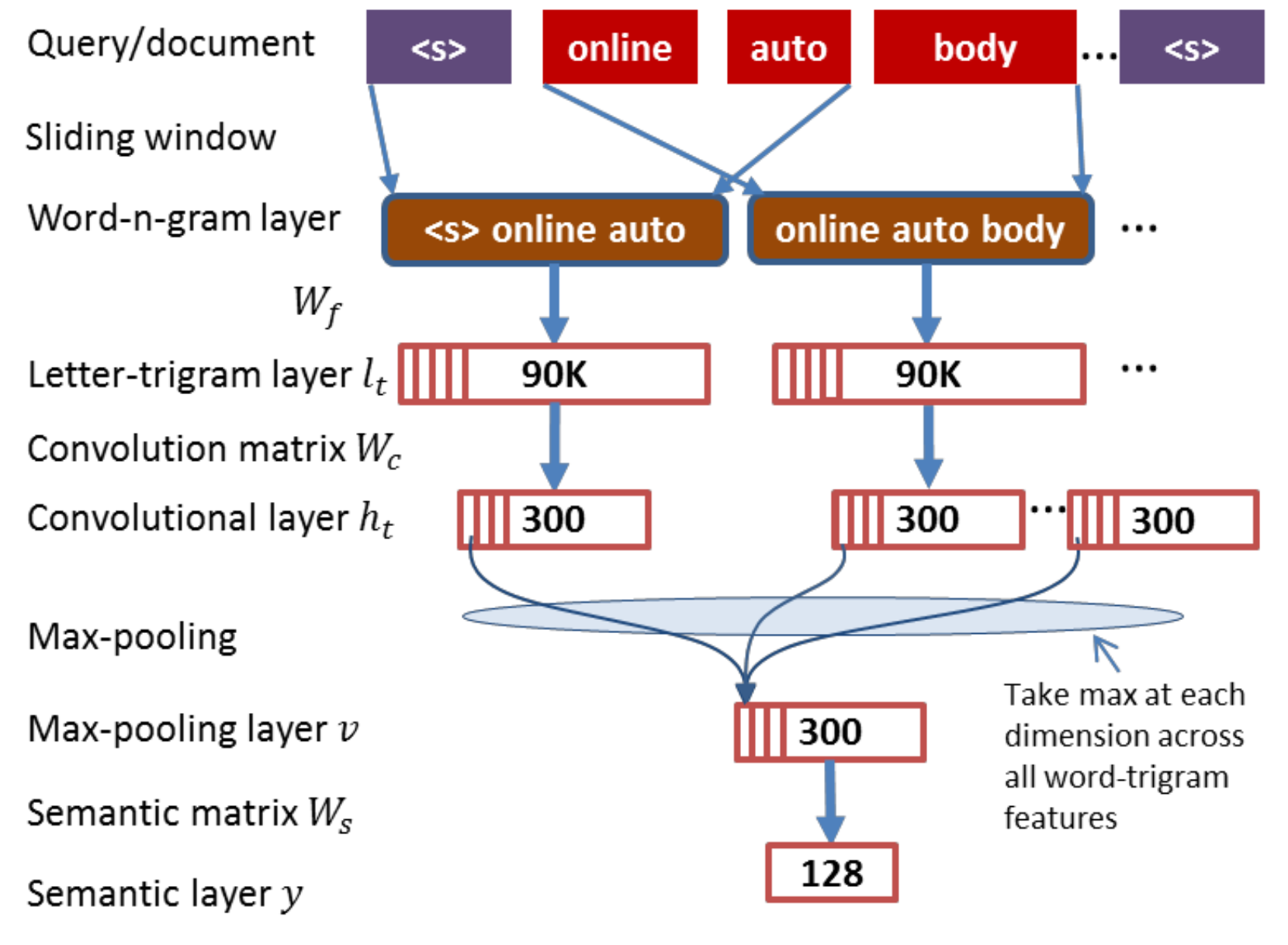

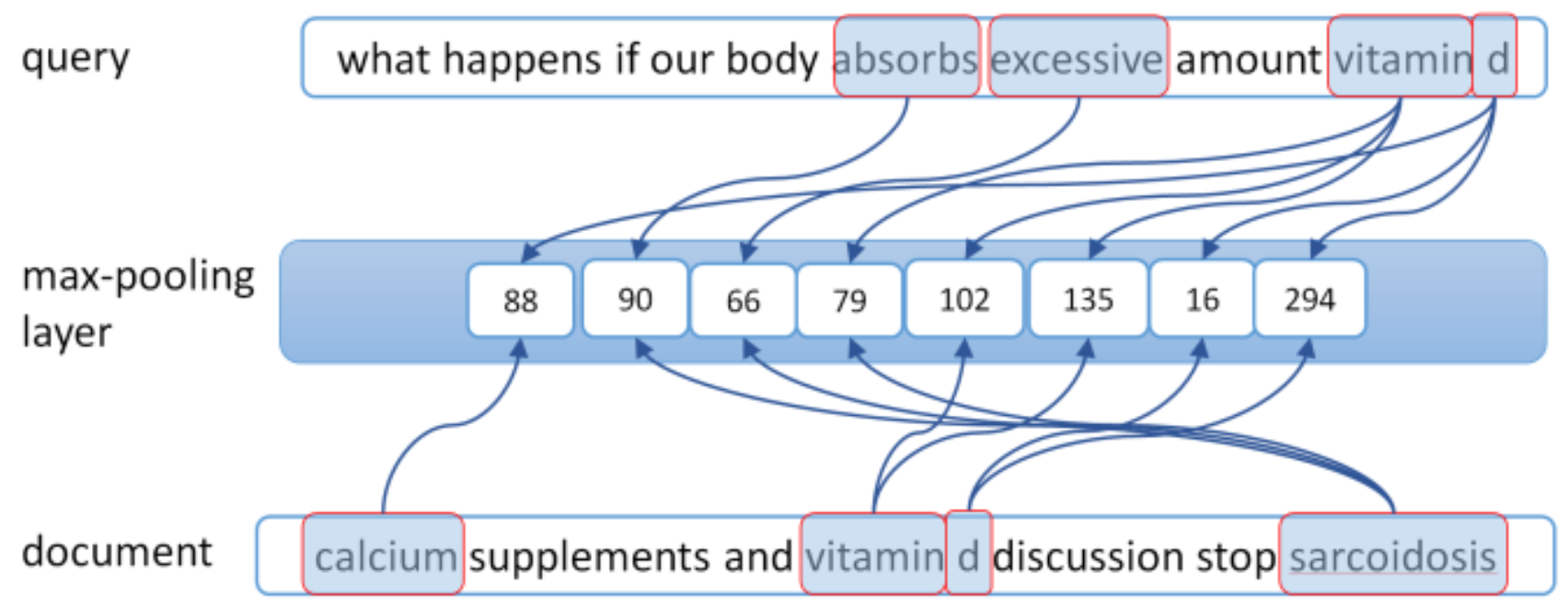

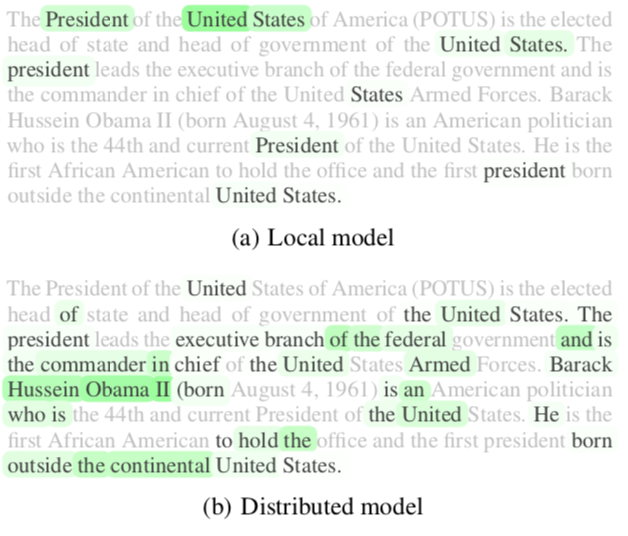

Textes courts : RI Adhoc

(suite)

- Entrainé sur 12.071 questions (non public)

- Document = titre

- Visualisation :

Shen, Y., He, X., Gao, J., Deng, L., & Mesnil, G. A Latent Semantic Model with Convolutional-Pooling Structure for Information Retrieval. CIKM 2014.

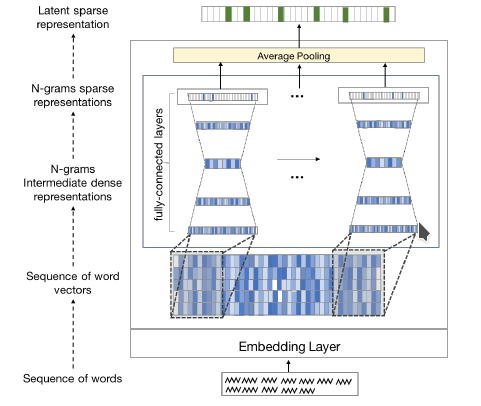

SNRM: Représentation parcimonieuse

- Grand espace de représentation (= index) ~ 5-20k

- Utilisation d'une régularisation parcimonieuse $$L = \Delta(q, d^+, {d^-}) + \color{red}{\| q \|_1 + \| {d^-} \|_1 + \| {d^+} \|_1}$$

Attention et interaction

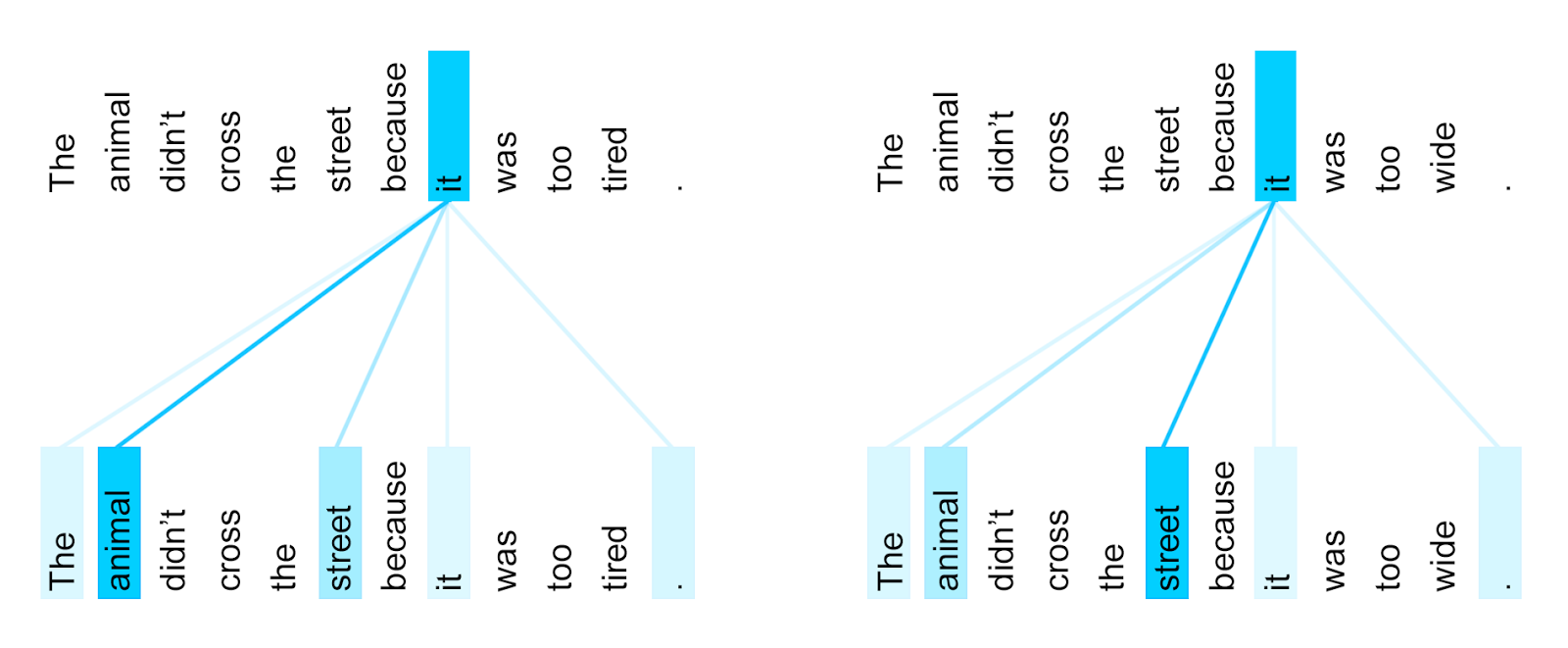

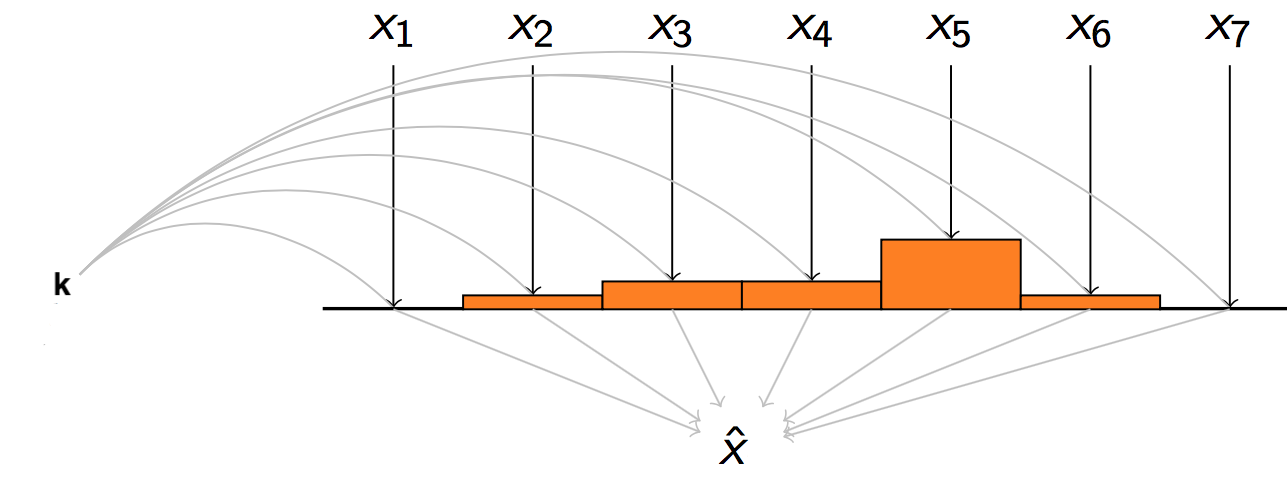

Mécanisme d'attention et de mémoire

But : améliorer la capacité des réseaux de neurones à traiter des tâches complexes. Appliqué dans les tâches de question-réponse (entre autres)

- Attention

- Permet de se focaliser l'attention sur certaines parties des entrées

- Mémoire

- Permet de lire et d'écrire dans une mémoire

Attention

Interaction

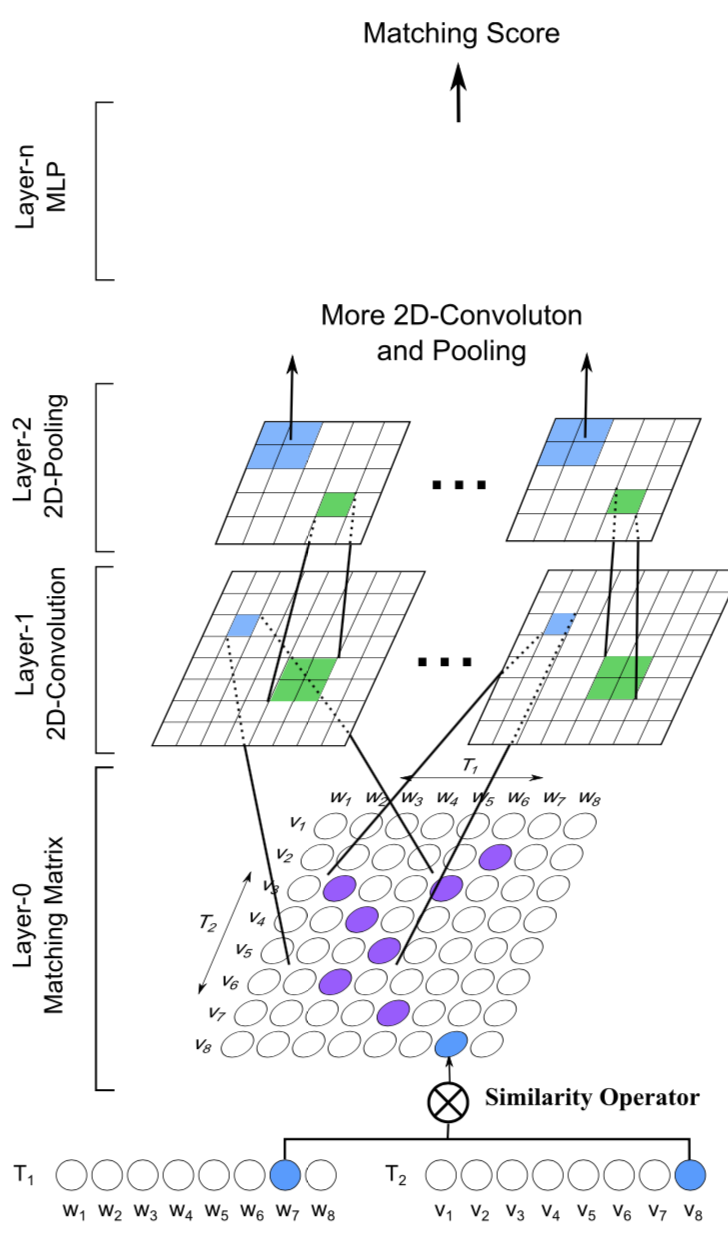

MatchPyramid

- Matrice d'interaction

- Modèle de convolution 2D

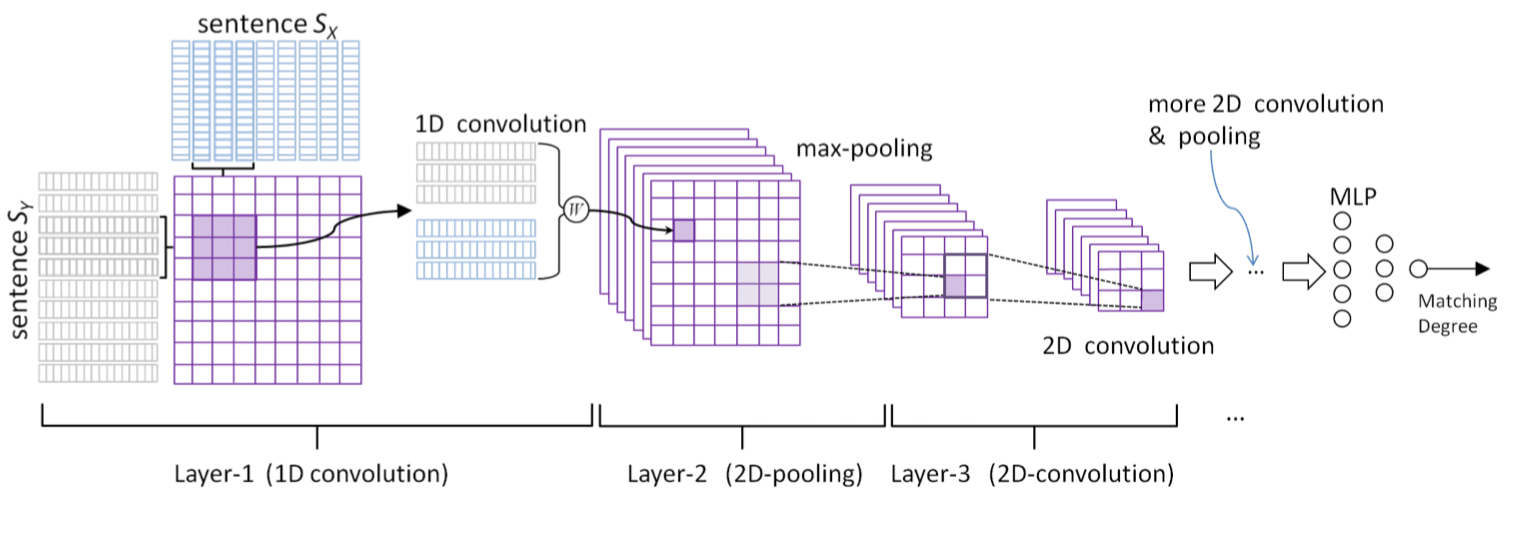

ARC-II

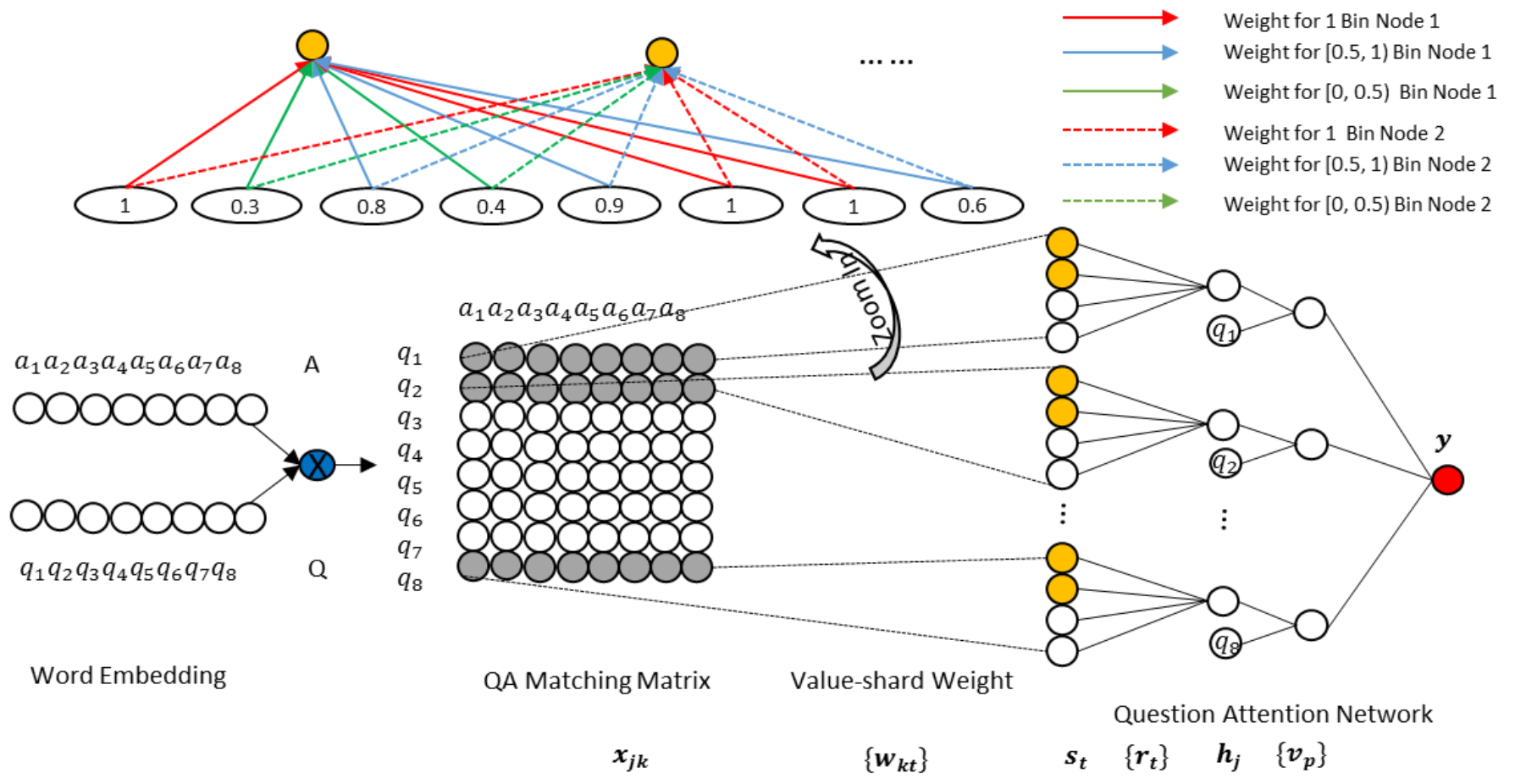

Modèle d'attention (aNMM)

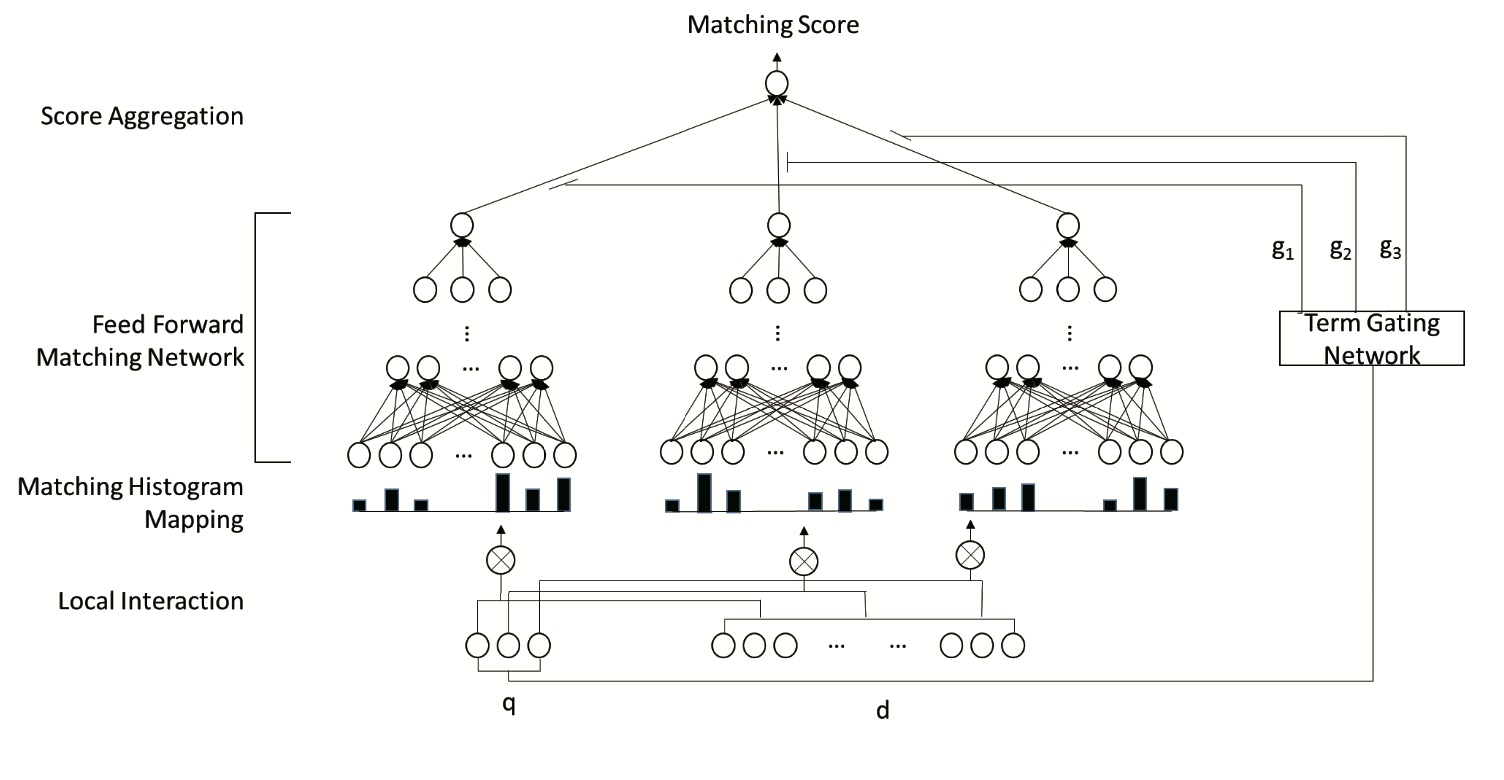

A Deep Relevance Matching Model (DRMM)

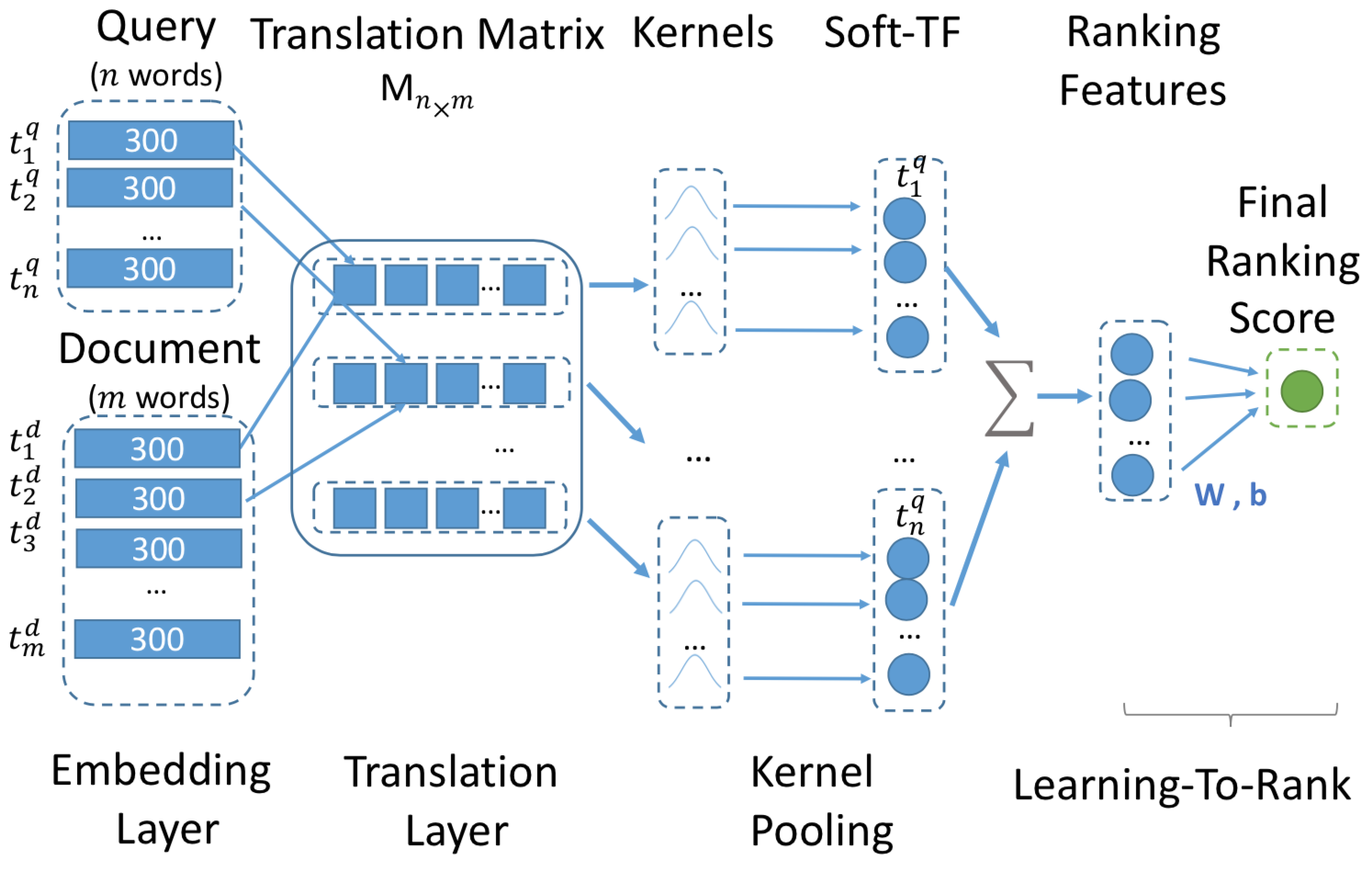

Kernel Neural Relevance Model (KNRM)

Textes courts: Re-ranking de réponses

Experiments: QA Trec Dataset

Duet: Combiner local et global

- (DSSM)Huang, P. et al.2013. Learning Deep Structured Semantic Models for Web Search Using Clickthrough Data.

- (MatchPyramid)Pang, L. et al.2016. Text Matching as Image Recognition.

Comment apprendre ?

Coûts

On calcule sur l'ensemble de la base d'apprentissage $\mathcal D$

$$ \sum_{x \in\mathcal X} \Delta(x, f_\theta(x)) $$ où $\Delta$ mesure l'erreur par rapport à la sortie désirée en fonction de la tâche.Coûts : régression

L'ensemble d'apprentissage = paires entrée/sortie désirée $$ \mathcal D = \left\{ (x_i, \hat y_i) \right\} $$

Coût quadratique $$\Delta(f_\theta(d), \hat y) = \| y - \hat y\|^2$$

Applications : échelles ordinales

- Score d'un document

- Sentiment

- ...

Coûts : classification

L'ensemble d'apprentissage = paires entrée / classe $c\in\{1, \ldots, k\}$ $$ \mathcal D = \left\{ (x_i, \hat c_i) \right\}_i $$

La fonction $f_\theta$ renvoie un vecteur $\mathbb R^k$, $$ f_\theta(x) = \left( p(c=1|x; \theta), \ldots, p(c=k|x;\theta) \right) $$

Coût cross-entropique $$ \Delta(f_\theta(x), \hat c) = \log p(c=\hat c | x; \theta) = \sum_{c} \Ind{c = \hat c} \log \left(f_\theta(x)\right)_{\hat c} $$

Applications

Coûts : Ordonnancement

L'ensemble d'apprentissage = paires d'objet (ex. document) avec $x_+ \succ x_-$ $$ \mathcal D = \left\{ (x_i^+, x_i^-) \right\}_i $$ La fonction $f$ donne le score d'un objet

Application

- Apprendre à ordonner des documents, des relations, etc.

Supervision Faible

- Reformulation

- Clics

- ...

Conclusion

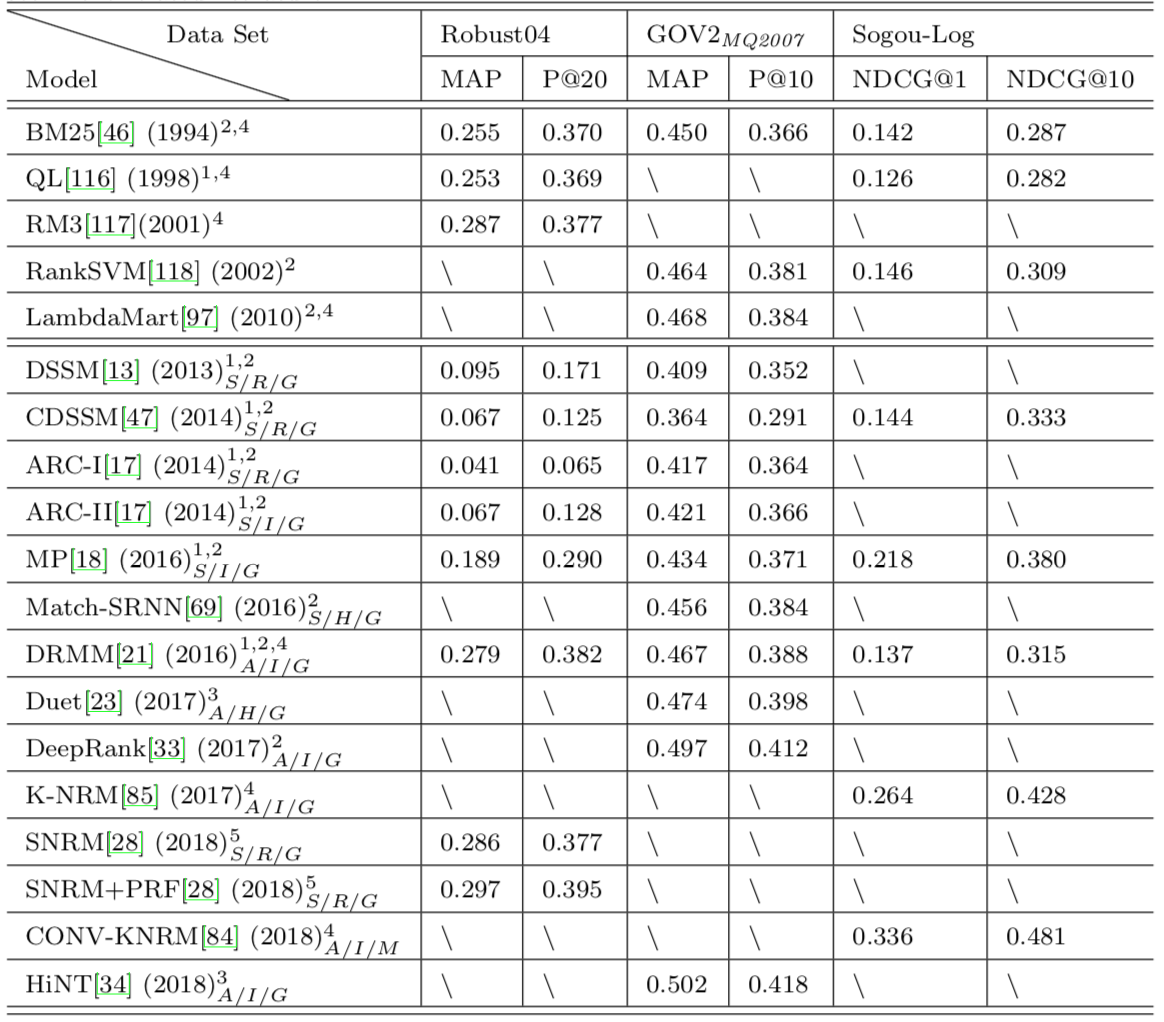

Résultats en RI

Résumé

Différents cas d'usage en fonction des données disponible et de la granularité du traitement

Données

- On a plein de données représentation directe

- On a peu de données interaction / approche indirecte

Granularité

- Fine (phrase) interaction/représentation, symétrique

- Moyenne (passage) interaction/représentation, symétrique

- Grande (document) interaction, asymétrique

Nouveaux modèles en NLP: Bert